Cesena

Intelligenza artificiale, siamo all’alba di una nuova società

L’intelligenza artificiale è il presente, non il futuro. Già oggi trova spazio in molti settori e non potrà che occuparne altro con il passare del tempo. Ma si può davvero definire intelligenza? E se sì, di che tipo?

L’evento organizzato ieri sera al palazzo del Ridotto di Cesena dall’associazione Benigno Zaccagnini, assieme al Movimento federalista europeo e il sindacato Cisl, ha affrontato l’argomento dal punto di vista antropologico: «Non si tratta di un tema solo tecnico – ha introdotto la serata il presidente dell’associazione Damiano Zoffoli – ha risvolti di natura educativa, politica, economica. Ci interroghiamo sul futuro dell’uomo».

Claudio Arlati, formatore e ricercatore Ial e docente in master universitari, ha ripercorso la storia dello sviluppo delle macchine “intelligenti”. Sgombrando subito il campo dagli equivoci: «Non ci aspetta un mondo governato da Hal9000, il computer del film “2001 Odissea nello spazio” che uccide gli astronauti».

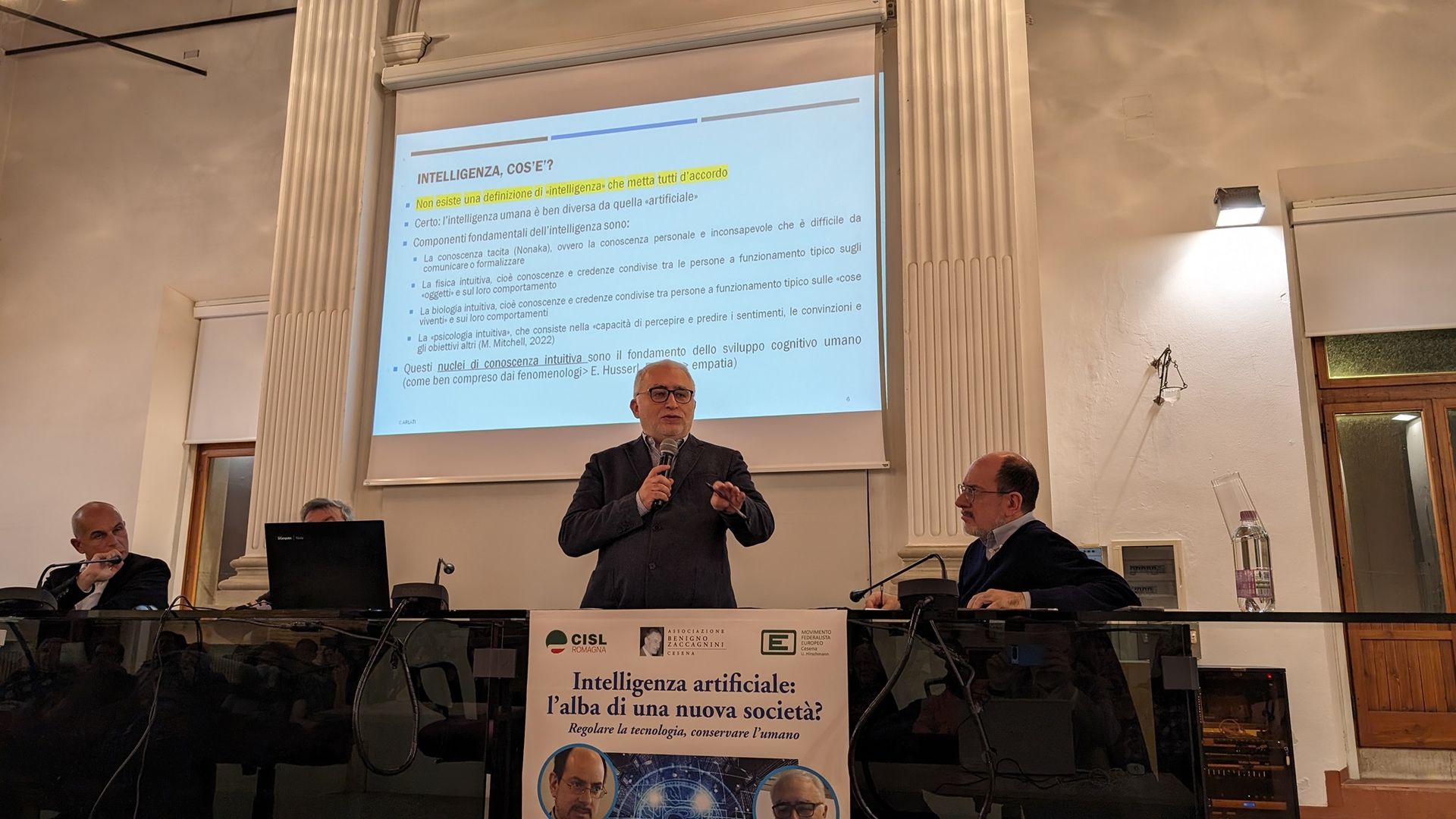

Per Arlati: «L’intelligenza artificiale non è in alcun modo confrontabile con l’intelligenza umana. E non c’è una definizione di intelligenza che metta tutti d’accordo. Ad oggi l’IA non possiede elementi chiave dell’intelligenza umana, come la “conoscenza tacita”, la fisica intuitiva, la biologia intuitiva e la psicologia intuitiva, fondamenti dello sviluppo cognitivo umano».

Di più, citando il matematico e filosofo italiano Gian Carlo Rota, Arlati ha sottolineato come «Siamo molto lontani dalla possibilità di produrre macchine che infrangano la barriera del significato. Probabilmente non ci sarà mai una macchina che capisca quanto può capire una persona».

Eppure già oggi gli algoritmi dell’IA rispondono in maniera “intelligente” e producono testi e immagini. «Bisogna superare l’idea antropocentrica di intelligenza, riconoscendo che ci sono altre forme di intelligenza diverse da quella umana, come sottolinea il docente universitario di IA Nello Cristianini. Anche il calamaro, il cui cervello è ricco di terminazioni nervose, può pensare e decidere di muovere i propri tentacoli in un modo o nell’altro per rapportarsi meglio al proprio contesto. L’intelligenza artificiale va intesa come aliena, più simile a quella di un calamaro che di un essere umano».

In attesa di una fantomatica quanto improbabile “IA forte” (macchina autocosciente), si stanno accumulando nel mondo molte “IA deboli”, capaci di intelligenza aliena. Ognuna di queste “ragiona” con degli algoritmi, ricette pensate da persone che hanno pregiudizi e condizionamenti. Questi algoritmi sono dotati di retro-propagazione, possono cioè imparare ed essere addestrati. Per questo servono delle regole per l’IA e il Parlamento europeo è stato il primo al mondo a definirle con il cosiddetto “AI Act” (che diventerà operativo non prima di due anni).

Nel lavoro e nella formazione, per Arlati «Bisogna imparare a convivere con queste intelligenze aliene. L’IA ha il potenziale di migliorare la vita lavorativa di ognuno, a partire dai più deboli e dalle persone “non a funzionamento tipico”, riducendo i compiti di routine. Ma tutto dipende dagli attori istituzionali e sociali». Secondo l’esperto in Italia non c’è al momento un rischio di licenziamenti di massa: «La digitalizzazione non si è accompagnata a un taglio dei posti di lavoro, anche a causa del basso livello degli stipendi nel nostro Paese».

Resta comunque importante il tema della partecipazione dei lavoratori e dei loro rappresentanti nella gestione di questi processi: «In Germania si sono rinnovate le norme sui consigli di fabbrica e i lavoratori possono dire la loro sull’implementazione dell’IA nei processi di produzione».

È poi intervenuto Ernesto Diaco, insegnante, giornalista e autore di diverse pubblicazioni. Cesenate, è stato a lungo viceresponsabile del Servizio nazionale Cei per il progetto culturale, mentre da nove anni è direttore dell’Ufficio nazionale Cei per l’educazione, la scuola e l’università.

Diaco si è soffermato sulla “algoretica”, ossia l’approccio etico da tenere nello sviluppo degli algoritmi di IA e nell’uso degli stessi. Il termine è stato coniato dal teologo francescano Paolo Benanti, membro di un gruppo di esperti Onu sulla materia e presidente della Commissione IA del Governo italiano.

Lo ha fatto a partire dalle parole di papa Francesco nel messaggio del gennaio scorso per la 57esima Giornata mondiale della pace: “Giustamente ci rallegriamo e siamo riconoscenti per le straordinarie conquiste della scienza e della tecnologia, grazie alle quali si è posto rimedio a innumerevoli mali… – scrive il pontefice nel testo -. Allo stesso tempo, i progressi tecnico-scientifici, rendendo possibile l’esercizio di un controllo finora inedito sulla realtà, stanno mettendo nelle mani dell’uomo una vasta gamma di possibilità, alcune delle quali possono rappresentare un rischio per la sopravvivenza e un pericolo per la casa comune”.

Inquietanti, in questo senso, sono le risposte date da alcune IA alla risposta su come ottenere la pace. In tutti gli scenari prevedevano una corsa agli armamenti, attacchi, fino all’uso dell’atomica. Ma a far la differenza, come detto, è il modo in cui gli algoritmi vengono “formati”.

Citando lo storico della tecnologia Melvin Kranzberg, secondo cui «La tecnologia non è né buona né cattiva, ma non è neanche neutrale», Diaco ha rimarcato come «dietro ogni tecnologia c’è sempre una visione dell’uomo».

Già oggi l’intelligenza artificiale è utilizzata in moltissimi ambiti: dal riconoscimento vocale ai filtri antispam, dalle chat del servizio clienti ai motori di raccomandazione prodotti, passando per le tecnologie di guida “autonoma”, al trading automatizzato fino all’industria militare.

Ma questi utilizzi di settore potranno mai convergere in una “SuperlA generale”? Diaco è convinto di no: «È fantascienza. Ho letto articoli che dicono che potrebbe arrivare entro tre anni, ma è un’utopia. Oggi il computer più potente al mondo ha impiegato 40 minuti per simulare un secondo di attività cerebrale umana».

Il pericolo di una super intelligenza artificiale in grado di assumere il controllo del mondo, a danno degli uomini, sembra lontano. Ma il rischio che le persone credano a messaggi fuorvianti generati dall’IA, a scopo commerciale o politico, è assai elevato. Già oggi alcune IA non si limitano a generare immagini realistiche, ma anche video. Tanto che di recente, per fare un esempio, la Conferenza episcopale messicana è stata costretta a bollare come “fake” un video del cardinale Carlos Aguiar Retes, dove l’immagine del primate del Messico veniva usata a sua insaputa per reclamizzare una presunta cura miracolosa contro il diabete.

Ecco che, usando le parole di padre Paolo Benanti, l’Algoretica è importante non solo per addestrare gli algoritmi, ma anche gli utilizzatori degli stessi: «Si tratta in prima istanza di lasciare sempre uno spazio per l’uomo e per il suo mondo di valori con cui giudicare: questo atto potrà essere a volte precario e incerto, ma insostituibile e non surrogabile dalla macchina».

Diaco ha chiuso il suo intervento così come lo aveva iniziato, con una citazione di papa Francesco, questa volta dalla 58esima giornata delle Comunicazioni sociali: «Spetta all’uomo decidere se diventare cibo per gli algoritmi oppure nutrire di libertà il proprio cuore, senza il quale non si cresce nella sapienza. Questa sapienza matura facendo tesoro del tempo e abbracciando le vulnerabilità. Cresce nell’alleanza fra le generazioni, fra chi ha memoria del passato e chi ha visione di futuro. Solo insieme cresce la capacità di discernere, di vigilare, di vedere le cose a partire dal loro compimento».